Intelligenza artificiale

Rimuovere la rabbia degli utenti contro gli operatori dei call center: fino a che punto i filtri IA si spingeranno ad annullarci

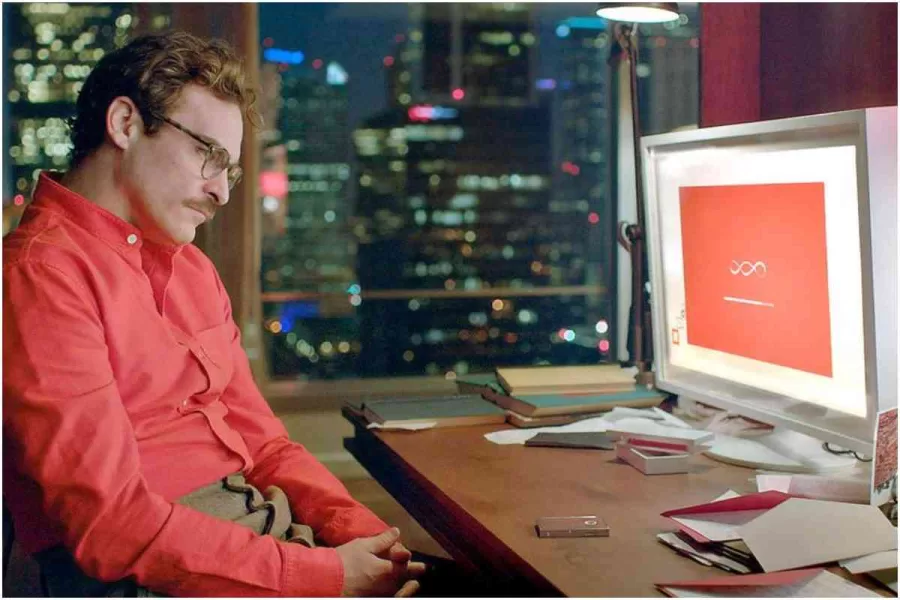

Nel film “Her”, uno scrittore solitario, Theodore Twombly, si innamora della voce disincarnata di Samantha, un’assistente digitale interpretata dall’attrice Scarlett Johansson. “Non riesco a credere che sto avendo questa conversazione con il mio computer”, dice Twombly a Samantha. “Non è così”, sussurra lei, “stai avendo questa conversazione con me”. La genialità di Spike Jonze – che ne ha scritto la sceneggiatura – sta proprio nell’esplorazione dei confini tra artificiale e reale. Il film di fantascienza, uscito nel 2013, è stato ricordato un paio di mesi fa dopo che OpenAI ha lanciato il suo ultimo chatbot di intelligenza artificiale multimodale GPT-4o , che apparentemente imita la voce di Johansson. Johansson ha affermato di aver rifiutato le richieste di OpenAI di usare la sua voce, aggiungendo di essere rimasta “scioccata e arrabbiata” nello scoprire che l’azienda ne aveva distribuita una “simile in modo inquietante” alla sua. Ha chiesto maggiore trasparenza e una legislazione appropriata per garantire che i diritti individuali fossero protetti. OpenAI ha sospeso l’uso della voce, che in seguito ha spiegato appartenere a un altro attore.

Furto d’identità, identità intellettuale e calo di fiducia

La controversia solleva almeno tre preoccupazioni più generali sull’IA generativa: il furto di identità, un certo indebolimento della proprietà intellettuale e un calo di fiducia. “Ciò che i modelli di IA consentono e non consentono definirà la nostra cultura di domani. È importante esaminarli attentamente prima di rilasciarli e adottare le misure necessarie per migliorare la trasparenza delle società che li sviluppano”, dice al Financial Times Percy Liang, direttore del Center for Research on Foundation Models di Stanford. Ma ormai non si tratta più solo della proprietà della voce: le tecnologie intelligenti si stanno interessando anche alle emozioni.

L’Emotion Cancelling

Si chiama “EmotionCancelling” e promette di rimuovere la rabbia dalla voce di chi parla. Il sistema, basato sull’intelligenza artificiale, è ancora in fase di R&S da parte di SoftBank, holding finanziaria multinazionale giapponese che l’ha presentato come una soluzione all’intollerabile carico psicologico imposto agli operatori dei call center e allo stress di essere presi di mira dai clienti arrabbiati.

La protezione dei lavoratori

La tecnologia altera la voce, modificando in tempo reale lo sfogo di chi chiama, ad esempio, per un disservizio: il vocabolario rimane intatto (per ora) ma il tono di voce viene reso neutro e la rabbia, dunque, “cancellata”. La commercializzazione e l’installazione nei call center, stima SoftBank, sono previste entro marzo 2026. Ma la protezione dei lavoratori non dovrebbe essere l’unica considerazione da fare: la rabbia è certamente molto spiacevole da subire, ma può anche essere legittima e oc-corre cautela nell’espungerla artificialmente fuori dal copione delle relazioni con i clienti. Rimuovere la rabbia dalla voce di qualcuno senza il suo permesso (o nascondere quel permesso in qualche minuscola clausola nei contratti) oltrepassa un limite importante, soprattutto quando è l’IA incaricata della rimozione. E il limite può considerarsi valicato quando l’emozione di una persona diventa una commodity e, in quanto merce, sia neutralizzata. Di fronte a tutto questo, verrebbe da dire che la strategia migliore è quella di restare infuriati. E a giudicare dagli annuali sondaggi di Gallup sullo stato emotivo del mondo, più arrabbiati e tristi lo siamo tutti: certo, gli afghani più dei danesi. Dunque, non basterà rimuovere un’emozione che trapela dalla voce di qualcuno per risolvere la situazione.

Ma allora perché non far sì che l’intelligenza artificiale protegga gli operatori dei call center anche da delusione, tristezza, disperazione o persino da un eccesso di gratitudine? Tra l’altro, dopo la pandemia, è esplosa una nuova tendenza sui social, in particolare su LinkedIn, un tempo asettica rete per lo sviluppo di contatti professionali: si chiama “vulnerability turn” ed è stata Shani Orgad, docente di media e comunicazione alla London School of Economics a descriverla. A un certo punto, gli utenti di LinkedIn non si vantavano più solo dei propri successi professionali, ma condividevano anche i momenti peggiori e le loro debolezze. Si chiamano ‘post snap’ (snap, letteralmente, significa “spezzarsi”, ndr) “e spesso includono immagini dell’autore in lacrime, accompagnate da testi che incoraggiano i lettori ad ascoltare sé stessi e a lasciarsi andare alla vulnerabilità”, scrive Orgad.

Memorabile, il post dell’amministratore delegato che ha pubblicato un selfie in lacrime dopo aver licenziato un dipendente, accompagnato da un testo che spiegava: “Questa sarà la cosa più vulnerabile che condividerò mai”. L’uomo è stato poi massacrato nei commenti e accusato di narcisismo ma la tendenza rispecchia un clima aziendale che incoraggia le persone a parlare delle proprie difficoltà, di salute mentale e fisica, sessualità o famiglia, nel tentativo di essere autentici. Ma la condivisione a tutti i costi di emozioni per loro natura intime, non è forse poco autentica e molto artificiale? E l’ironia, se non altro quella volontaria, che fine ha fatto in tutta questa sovraesposizione di fragilità? Eppure, gli studiosi ricordano, l’umorismo resta uno dei pochi tratti che differenziano gli esseri umani dai computer.

© Riproduzione riservata